谷歌发布视觉语言动作模型 RT-2,可以让机器人学会扔垃圾

IT之家 7 月 28 日消息,谷歌今日推出了一种新的人工智能(AI)模型 Robotics Transformer2(RT-2),可以帮助训练机器人理解扔垃圾等任务。

▲ 图源 谷歌 DeepMind 官网

谷歌表示,RT-2 是一种视觉语言动作模型,可将互联网上采集的信息和图像转化为机器人可理解的动作,从而帮助提升机器人的学习能力。

虽然像捡垃圾这样的任务对于人类来说听起来很简单,但机器人需要了解一系列知识后才能学习。例如,机器人必须首先能够识别哪些物品构成垃圾,然后要知道如何将其捡起来并扔掉。

RT-2 允许机器人使用来自网络的知识来帮助它理解如何完成任务,而不是为机器人编程来完成这些特定的任务。即使机器人没有明确地接受过确切步骤的训练,也能通过 RT-2 学会完成新的任务。

据《纽约时报》报道,谷歌近期没有计划发布或销售采用这项新技术的机器人,但最终这项技术或许可以用于仓储物流或家庭助理机器人。

免责声明:凡本网站发布的文章、图片、音频、视频等内容所表述的观点和立场不代表本网站的观点和立场,若对该观点或立场有疑义或异议,请及时用电子邮件或电话通知我们,以迅速采取适当措施,避免给双方造成不必要的经济损失。凡本网站发布的所有文章 、图片、音频、视频文件等资料的版权归版权所有人所有,本站采用的非本站原创文章及图片等内容无法一一和版权者联系,如果本网所选内容的文章作者及编辑认为其作品不宜上网供大家浏览,或不应无偿使用,请及时用电子邮件或电话通知我们,以迅速采取适当措施,避免给双方造成不必要的经济损失。

相关阅读

只是偶然搜索,天工AI竟然走心回答,勾起魔兽催泪回忆杀!

2024.04.30

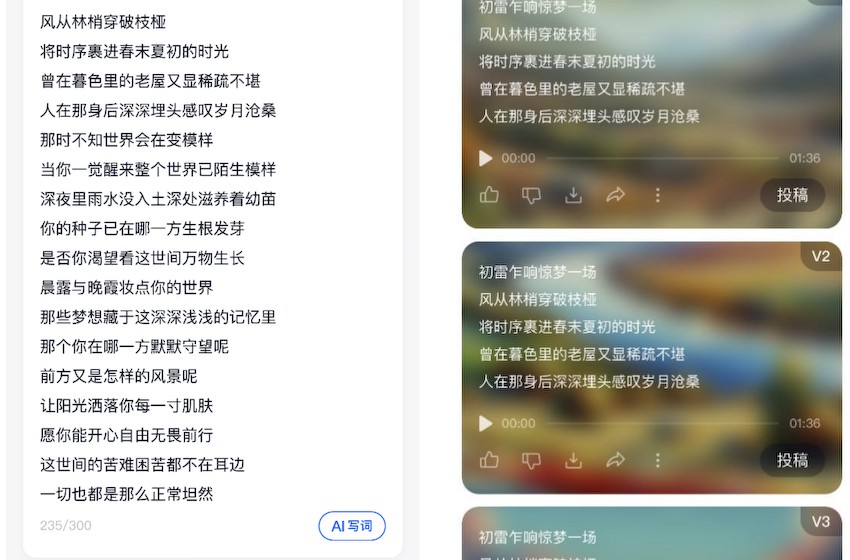

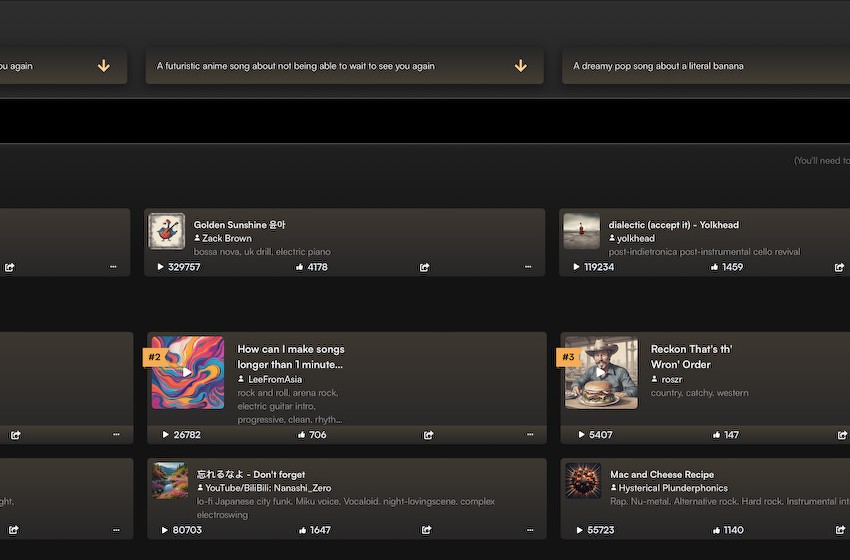

盘不完,根本盘不完……怎么没人早点告诉我AI音乐这么好玩

2024.04.25

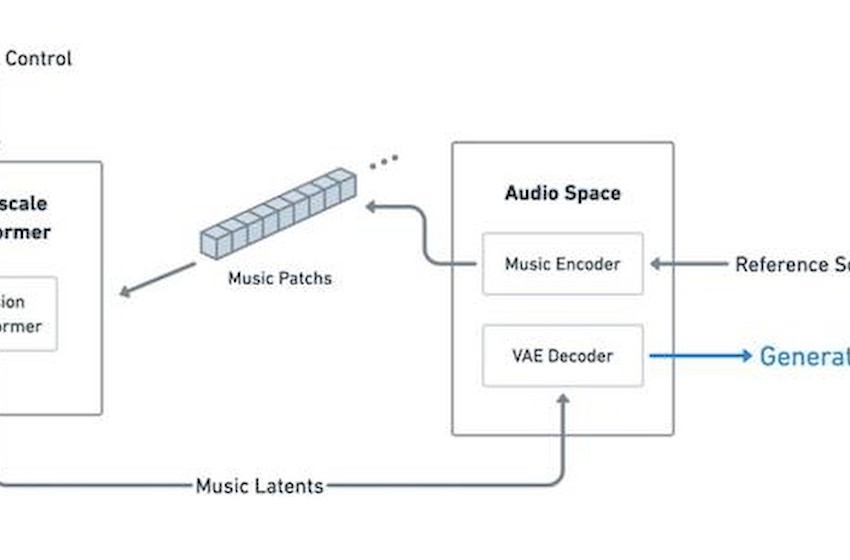

中国首个音乐SOTA模型「天工音乐大模型」今日公测

2024.04.17

解码「天工SkyMusic」,填补AI音乐领域技术空白

2024.04.12

「天工SkyMusic」跨界喜剧,用实验音乐探索笑声与旋律的碰撞

2024.04.11