造个破谣而已,咋还用上AI了?

最近,央视等各大媒体纷纷曝光了全国多起用AI炮制网络谣言的案例,其中涉及灾害、安全事故、刑事案件等多类谣言内容,造谣的方式更是从文案到图片、视频不一而足。

看到这样的消息,总是会加重我们对AI的担忧,联想到此前的AI诈骗、deepfake等,AI仿佛是越来越坏了,至少它已经变成了一种可以被不法分子利用的工具。

但也有网友问了,不就是造个谣吗?这东西去村口转一圈,听大爷大妈聊一会,轻轻松松能收集个百八十条的,怎么还得用上AI这种高科技了?这不法分子是太懒了,还是过于缺乏想象力?

这其实是个很重要的问题,我们今天就通过这些已经被公开报道的案例,来聊一聊用AI造谣背后的动机与行为逻辑。了解了这些之后,才能更有针对性、灵活性地遏制AI造谣。

正所谓恐惧源于未知。AI造谣这事,乍听起来魔幻且恐怖。但如果我们逐层拆解它、了解它,会发现不过尔尔。

不必恐惧AI。就像火能带来温暖也能带来火灾,绝大多数技术都是双刃剑。重点是谁来使用它,以及如何使用它。

从瞎编,到AI批量化高水准瞎编

在电影《保你平安》里,魏平安费劲千辛万苦,最后发现谣言来源不过是为了几块钱在论坛随便发了一句评论。

很多朋友看完电影觉得这样的动机有点离谱,但从曝光出来的AI造谣案件中,我们会发现这种卑鄙且低端的行为还真不在少数,只不过贪图论坛币的行为确实过分奇葩。大部分网络造谣者的利益动机,还是希望获取流量来换取平台补贴并变现,这也就导致他们需要在信息流或者短视频平台发布内容。

要知道,这些平台目前的流量补贴已经很低了,而即使是耸人听闻的谣言内容,也需要标题、文案、图片配合好,才能大差不差、以假乱真。结果往往是造谣者瞎编了半天,收益微乎其微。有这个能力和时间,可能还不如去找个文案、编辑类的工作来做。

这可怎么办呢?于是就产生了造谣者选择AI的第一个动机:更快、更简单地编造谣言。

我们能在很多案例里发现,用AI造谣并没有什么神秘的,不法分子就是需要AI的简单高效。根据《北京日报》8月1日报道,在一系列编造某地水灾的网络谣言背后,造谣者仅仅是利用手机浏览器自带的AI文本生成功能,输入了“暴雨”等相关关键词,就得到了水灾相关的新闻稿。

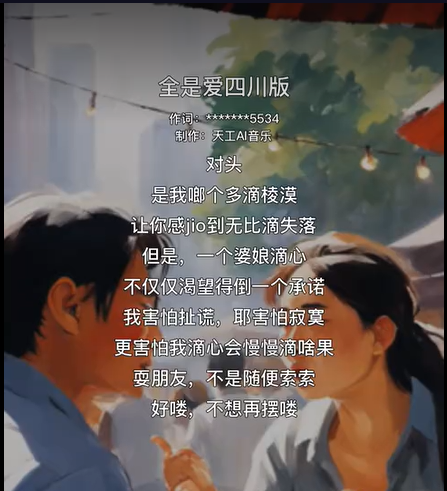

除了根据关键词直接生成通稿,AI文本生成还可以对已有文案进行渲染。造谣者会命令AI,对悬疑、惊悚、情绪对立等内容进行强化和夸大。由此生成看起来更真实细腻,且容易让人相信的谣言内容。换句话说,很多煞有介事的小作文原本要自己编,现在可以交给AI了。

还有一种用AI造谣的方法,是将原本的新闻进行移花接木。最近甘肃平凉市公布了一起案例,嫌疑人是通过AI软件来大量篡改此前的新闻内容。比如将新闻的地点、时间、人名进行替换,以此来批量制造谣言内容。这些谣言大部分是某地发生了自然灾害、交通事故、刑事案件。由于是批量制造,这些谣言涉及各个地方,加上不同地区的用户会被算法推荐本地新闻,这些某某地发生水灾、火灾的谣言很容易产生流量。

归根结底,AI技术在这些造谣事件中,起到的只是一个加速谣言生产的工具作用。假如没有AI,这些人大概率也会想到这种编造谣言的方式,只不过需要自己一点点编辑加杜撰。又或许,AI写稿能力的出现,让连造谣“辛苦”也不想吃的懒汉们找到了门径。

我们无需污名化AI。AI加速文案生成,这个能力本身是有价值的,只是好人和坏人看到了它的不同应用方式。

贴合大数据需求的精准造谣

造谣者利用AI技术,仅仅只有一个动机吗?其实也不尽然。

对于很多造谣者来说,有流量、有话题度就是他们的最终目标。无论是出于病态心理还是利益诉求,能让人看的谣言才对于造谣者来说具有价值,但想要实现这事,可能还真不那么容易。造什么谣才能让人想看呢?甚至于什么谣言才能在一大堆竞品谣言中脱颖而出呢?以前这可能需要造谣者一个个关键词,一个个谣言类型去尝试,但现在情况开始改变了,造谣者可能不知道,但是AI知道啊,于是他们可以直接命令AI来做。

这就引出了用AI造谣的第二个动机:利用AI洞察大数据的能力。

用过生成式AI的朋友应该有所体会,如果你向AI提出诸如“文案里要有网络梗”“文案要让年轻人爱看”之类的需求,会发现很多时候AI比我们更懂网络,更懂流量。甚至还可以让AI生成“老年人爱看”“能引发中年焦虑”“能挑起性别话题”等内容。

这背后的技术原理,就是大模型具有更好的泛化信息理解能力,可以将没有直接关联的信息按照语义结合在一起。显然,造谣者对技术原理不感兴趣,但很快掌握了大模型的应用窍门。

在河南郑州市通报的一起案例中,嫌疑人就是通过对AI下命令,进行提示的方式获得谣言内容的。他要求AI生成的内容要能吸引眼球,并且明确说明要让年轻人看到。在这些提示关键词的要求下,AI生成了很多内容,嫌疑人最终选择了自己比较满意的进行发布。

可以看到,这个造谣原理,基本已经跟现在很火的职业“AI提示工程师”非常相近了。AI大模型带来的底层逻辑变革之一,就是人类可以不用搜索和点击来进行数字化交互,而是直接向AI提出需求,这一点也先被造谣者学会了。

而让人啼笑皆非的是,这名嫌疑人提示AI制造的谣言,最终确实引发了关注。只不过在给造谣者带来二三百元收益的同时,还带来了法律的制裁。

有图,没真相

还有那么一些造谣者,他们想要造谣骗取流量或实现其他目的,但苦于没有能让人信服的所谓“证据”。毕竟大多数网友也知道,空口无凭,有图有真相,而一些谣言很快被拆穿,也是因为造谣者利用了此前网络上已经发布过的图片。比如说前不久的某流量明星火速辟谣事件。

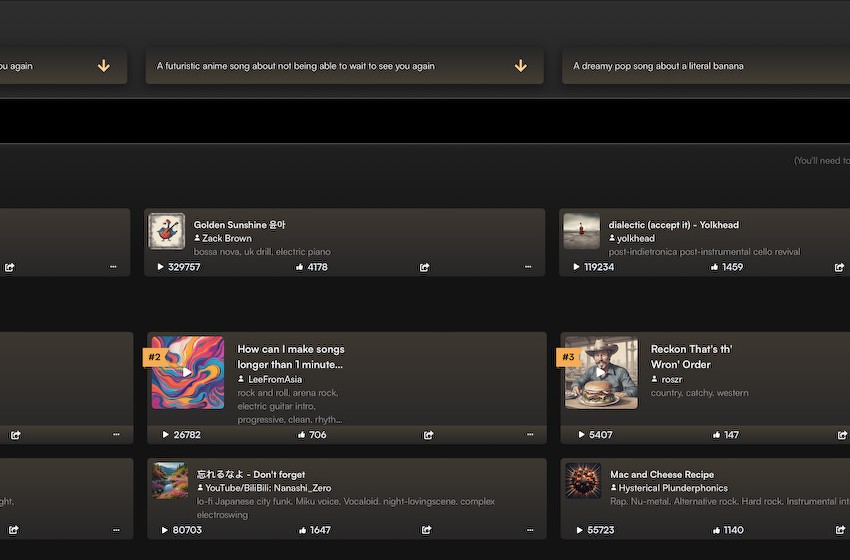

但如果能让AI做出来看着有点真,此前又没出现过的图片,这个难题似乎也就攻克了。于是就有了用AI造谣的第三个动机:通过AIGC平台来生成作为论据的图片。

还记得今年年初在土耳其大地震期间,就有人在推特上散布谣言,称自己是消防员、志愿者等,以此请求捐款。而信息中的配图就是AIGC平台合成的。由此可见,有图有真相的时代真的已经过去了。在今天,只要能够熟练使用AIGC软件,想要什么图基本都是可行的,而且很可能以假乱真。

这里要说的是,AIGC图片并没有那么神。其拟真程度甚至比不过大部分PS高手。但问题是,PS并非人人都会,使用AIGC则只需要按教程学一遍就能上手。于是不少游手好闲者开始用AIGC制造“谣图”,其中最恶心的一种,就是用AI来造黄谣。

不久前,《光明日报》就报道了一位女士在社交网络上发现了用自己面容合成的不雅图片。报道中还称,相关的AI制图工具堪称唾手可得,并且还有人在社交平台上兜售相关视频、订制换脸服务、贩卖操作教学等。

用AI换脸的Deepfake技术堪称屡禁不止,而AIGC平台的出现还让相关问题愈演愈烈。在一些缺乏监管的海外AIGC平台,用户基本可以在无技术门槛的情况下获得订制化的不雅图片。随着AI技术的前进,造谣者的工具箱也确实更加丰富了。

如何对抗这股歪风邪气?

奥尔波特在《谣言心理学》提出,想要限制谣言的传播,需要做到三件事:法律上严惩不贷、社会中进行阻隔、公民具备谣言意识。

其实最近备受关注的AI造谣,本质上与此前的网络谣言基本没有不同,唯一的变化就是造谣的门槛更底了,于是必然会有人觉得用AI造谣更加划算。

归根结底,大部分的AI造谣都是为流量和平台分成而来。这种造谣其实原本也有,但如果想要做大做强,可能需要几个写手、几个美工,有网络运营和大数据分析人员。类似电影《孤注一掷》里,诈骗集团就按“千门八将”分了八个部门,其中就有专门散播谣言的“谣部”。

但对于绝大多数造谣者来说,目标都仅仅是流量,而不是诈骗、勒索、敲诈这种重大刑事犯罪,他们的贼心和贼胆都不够,并且也不会写,不会P图。

于是对于他们来说,用AI来炮制谣言就显得更加划算,尤其在大模型出现之后,一个人就可以是一只谣言队伍,基本不用分工协作。

想要让这股AI造谣的歪风邪气不再猖獗,也需要从这三个方面入手,让AI造谣变得不再那么具有性价比。

首先当然是严惩不贷。从目前曝光的AI造谣案例中来看,大部分造谣者都是产生的影响很坏,但真正的收益很少。持续的犯罪打击与案例宣传,会让更多造谣者与准造谣者看到,AI造谣虽然看似成本低,但其实是非常不具备性价比的一件事。

接下来是建立造谣者在炮制、传播、获利等环节中的社会阻隔。很多相关讨论,都说可以用AI来检测AI内容,用魔法打败魔法。事实上,这样做当然可以,但技术上的实现空间很窄。比如说,让AI炮制一条假新闻很容易,但要让AI对比所有新闻数据,然后确定某条信息是假的,这个技术难度相当大。AI检测谣言工具,在一段时间内将更多是辅助性质。

想要从技术上建立造谣者与AI工具之间的组个,还是需要从AIGC工具上入手。让AI模型知道自己在写什么、生成什么图片,一旦遇到不合理、不合法的内容主动屏蔽,从而让造谣者不能那么顺利地应用AI。

与此同时,还需要在利益层建立给造谣者建立阻隔。大多数AI造谣案例的获利方式都是平台分成。那么我们是不是可以考虑唯流量论的分成体现机制是否过于简单粗暴?且必然给谣言留下了滋生空间?毕竟没人看狗咬人,都想看人咬狗。降低、甚至切断这些毫无营养的谣言内容获利渠道,也是重要的社会阻隔方式。

最后才是用户必须提高谣言意识。毕竟绝大多数人不是专家,不可能就看到的每条信息都考证二三,因此确实不能将太多分辨谣言的责任推给最终用户。但至少我们需要知道,确实有AI炮制假新闻,AI伪造图片这种可能性的存在。

另外还是想说,AI不可怕,用AI造谣也不可怕。心怀不轨之人,会利用一切可资利用的技术与工具。今天有AI,明天就有BI、CI,他们瞧上了AI,恰好说明AI确实已经做到了可利用和低门槛,如果因此就怀疑和污名化AI,岂不就把它白白让给了到处散德行的小人?

技术没有好坏,人心才有。