隐私保护更困难了?院士建议:用这种技术为大模型戴上紧箍咒

中新经纬9月7日电 (常涛)大模型的生成能力让“隐私泄露”的方式变得多样化,造成隐私保护更加困难,怎么办?

在9月7日开幕的2023 INCLUSION·外滩大会上,中国科学院院士何积丰开出了他的“药方”:利用对齐技术为大模型戴上紧箍咒。

何积丰认为,大模型的安全问题主要是在未经同意的情况下,收集、使用和泄露个人信息。隐私问题既可能发生在训练过程,也可能发生在使用过程中。而模型的通用能力,又让其能够应用到人类生产生活的各个场景中,可谓“无孔不入”,这就带来了很大的安全隐患。

“为了应对这些问题,我们需要大模型对齐技术。”何积丰说,“对齐(alignment)”是指系统的目标和人类价值观一致,使其符合设计者的利益和预期,不会产生意外的有害后果。“如果把人工智能看作西游记里的孙悟空,‘对齐’就是唐僧的紧箍咒。有了紧箍咒,就可以保证技术不会任意使用能力胡作非为。”

不过,对齐技术同样面临挑战。首先,对齐的基础,需要保证大模型为人服务、与人为善;其次,大模型的有用性与无害性之间目标也不完全一致。如何对错误进行有效纠正,设好大模型的“紧箍咒”也是挑战。

因此,对齐技术已经成为了一项令人眼花缭乱的跨学科研究,不仅考验技术,也审视文化。何积丰介绍,反馈强化学习是实现对齐的技术途径,目前有两种方式,一种方式是通过人工反馈给模型不同的奖励信号,引导模型的高质量输出;另一种方式,事先给大模型提供明确的原则,系统自动训练模型对所有生成的输出结果提供初始排序。“这意味着,不仅智能系统需要向人类价值观对齐,人类的训练方法也要向价值观对齐。”何积丰说。

中新经纬版权所有,未经书面授权,任何单位及个人不得转载、摘编或以其它方式使用。

责任编辑:罗琨 李中元

免责声明:凡本网站发布的文章、图片、音频、视频等内容所表述的观点和立场不代表本网站的观点和立场,若对该观点或立场有疑义或异议,请及时用电子邮件或电话通知我们,以迅速采取适当措施,避免给双方造成不必要的经济损失。凡本网站发布的所有文章 、图片、音频、视频文件等资料的版权归版权所有人所有,本站采用的非本站原创文章及图片等内容无法一一和版权者联系,如果本网所选内容的文章作者及编辑认为其作品不宜上网供大家浏览,或不应无偿使用,请及时用电子邮件或电话通知我们,以迅速采取适当措施,避免给双方造成不必要的经济损失。

相关阅读

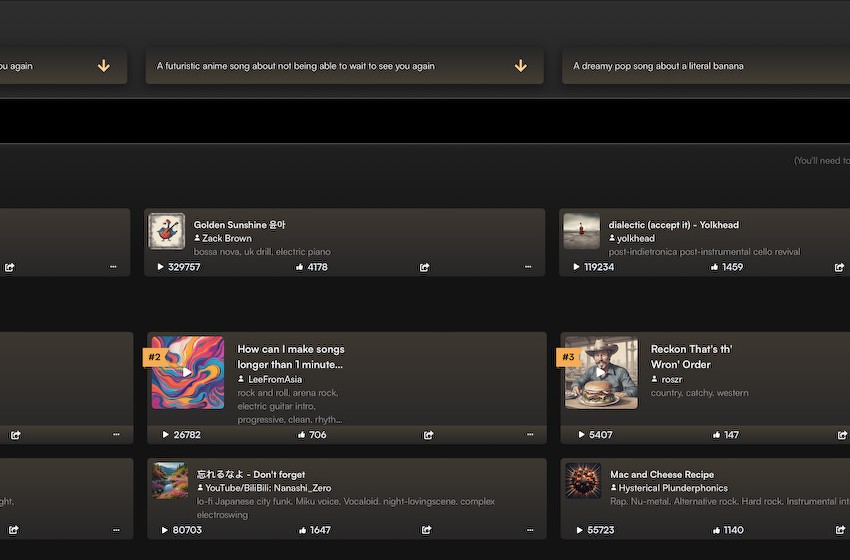

以假乱真,天工音乐大模型带来颠覆式AI体验

2024.04.03

《天空之城》背后可能不知道的深刻寓意!

2023.10.19

国家新闻出版署宣布实施“网络游戏精品出版工程”

2023.10.19

杜华说不想再养NAME了:女团去养猪?

2023.10.19

《仿生人间》首播,刘琳表现惊艳,这次,科幻剧好像又淘到宝了

2023.10.19