李开复李彦宏奥特曼获评全球AI领袖,《时代》出品,全球100人

西风 发自 凹非寺

量子位 | 公众号 QbitAI

《时代周刊》首次发布世界AI最具影响力人物榜。

100位学界业界大佬齐聚于此。

这其中就包括吴恩达教授、李飞飞教授、创新工场CEO李开复、百度CEO李彦宏、OpenAI CEO Sam Altman、马斯克、英伟达黄仁勋、 AlphaGo之父Demis Hassabis、中科院自动化研究所研究员曾毅等。

值得一提的是,马斯克是以xAI创始人入围。

此外一些科幻作家、音乐家等也以塑造者身份上榜了,名单上最年轻的仅有18岁,最年长的是76岁Geoffrey Hinton。

Time AI 100

《时代》的这份榜单共将这些在AI领域具有影响力的人分成了四类:领导者、创新者、塑造者以及思想者。

吴恩达,创新工场李开复,百度李彦宏,OpenAI CEO Sam Altman,Anthropic CEO和总裁Dario、Daniela Amodei,马斯克,OpenAI联创Greg Brockman……都在领导者阵营中。

以创新方式思考和探讨人工智能如何影响社会的人也受到了赞赏,这里面就包括音乐家Grimes、华裔科幻作家Ted Chiang、《黑镜》创作者Charlie Brooker等。

这份榜单还表彰了致力于AI伦理、偏见和安全的科学家、教授、研究人员等,中科院自动化研究所研究员曾毅、李飞飞、深度学习三巨头等都在思想者之列。

上榜者都说了啥

《时代》也几乎采访了每个上榜的人,来看看AI圈最有影响力的人都说了啥。

黄仁勋

每个人现在都是程序员,你只需要对计算机说点什么。

1993年,黄仁勋创办了英伟达。2001 年入选《财富》40 岁以下最富 40 人;2020 年入选《2020 福布斯全球亿万富豪榜》。

今年五月,英伟达成为首家市值达到1万亿美元的芯片企业,也是史上第九家跨入美元市值“万亿俱乐部”的企业。

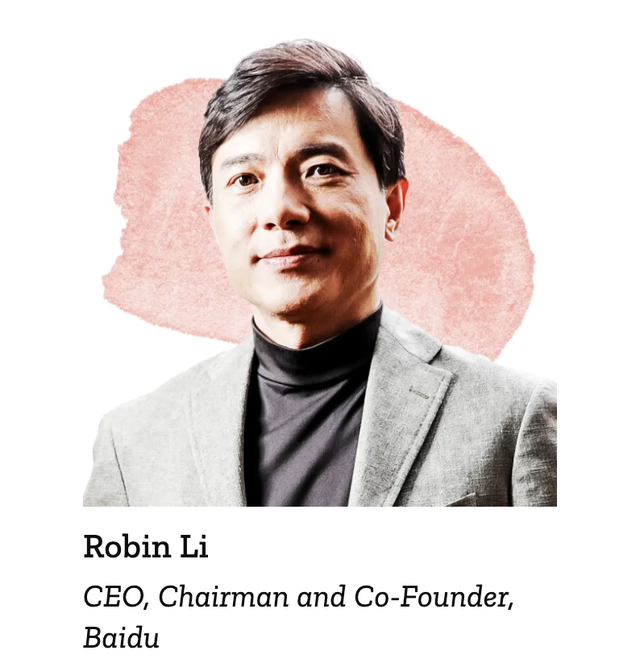

李彦宏

人工智能现在具备了以前无法实现的各种逻辑推理能力。

李彦宏2000年创立百度,2018年登上《时代》周刊2018年首期封面,也成为了首位登上《时代》封面的中国互联网企业家。

李彦宏将当前拐点与移动互联网的诞生进行比较,后者催生了像Uber、微信、TikTok这样的应用,而当前拐点预计会产生“数以百万计的新的、面向人工智能的应用”。

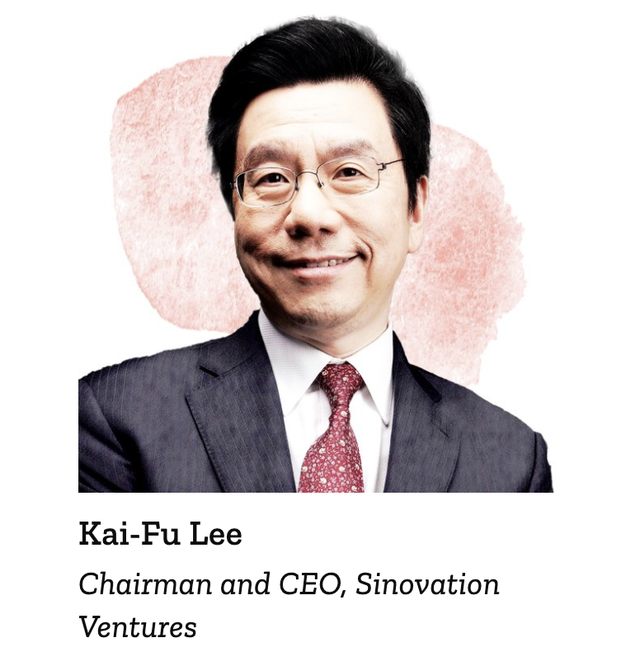

李开复

需要做更多的工作。当人工智能变得很强大,能够提出我们之前不知道的东西时,它可能被用来想出伤害他人的新方法、制造武器,或用错误信息操纵人们谋取利益。

2018年,创新工场的董事长兼CEO李开复曾写道,通用人工智能(AGI)——一种假设的未来技术,可以比人类更好地执行大多数认知任务——仍然需要几十年的时间才能实现。

然而,此时李开复告诉《时代》杂志,像ChatGPT这样的大语言模型(LLM)应用的快速发展意味着“从某些角度来看,我们已经实现了它,从其他角度来看,它近在眼前“。

曾毅

我觉得我有责任让世界知道。

曾毅现为中国科学院自动化研究所研究员,研究领域包括类脑AI、AI哲学与伦理等。

2016年开始,曾毅更加关注AI系统带来的风险,开始花更多的时间与政策制定者合作,制定有利于AI发展的规则,曾参与了联合国教科文组织关于人工智能伦理的建议的制定。

Demis Hassabis

人工智能研究领域最迫切需要发生的事情之一是制定正确的能力评估基准。

Demis Hassabis是DeepMind CEO,一直领导着一支计算机科学家组成的团队,在AI领域取得了众多突破,比如解决了蛋白质折叠等问题,他还是AlphaGo之父。

2014年DeepMind被谷歌收购;2023年4月,DeepMind重新组织了AI团队,与谷歌大脑合并。Hassabis表示“两个团队之前已经在做所有这些事情。但现在我会说,我们以更大的强度和速度在推进”。

Elon Musk

“TruthGPT”

马斯克是特斯拉创始人兼CEO、SpaceX CEO、推特(X)CEO、Neuralink创始人。

2018年从OpenAI离开时,马斯克承诺要做自己的聊天机器人“TruthGPT”。尽管马斯克在AI领域领先,但他仍担心AI可能对人类构成威胁。

Sam Altman

我们有责任告诉政策制定者和公众,告诉他们我们认为正在发生什么、可能会发生什么,将技术呈现给世界,让人们看到它。

Sam Altman是OpenAI CEO,2022年11月OpenAI发布震撼世界ChatGPT。

他对《时代》表示,人类足够聪明,适应能力也足够强,可以应对越来越强大的AI向世界释放,只要AI的问世是安全和渐进的,“社会有能力适应,因为人们比很多所谓的专家认为的要聪明得多,我们可以管理好这个”。

吴恩达

构建“AI应用”的唯一途径就是赋予全球许多人使用这些工具的能力。

2012年,当时是斯坦福大学教授的吴恩达向谷歌高层提交了一份提案。他主张谷歌应该利用大量算力,训练神经网络,这样做可以实现通用人工智能(AGI)。

十年前讨论这个话题,可能会被认为是一个“怪人”。但即便如此,吴恩达在那时对AGI的态度依然是“非常乐观”。

而今天他再次押注,“我认为我们没有理由认为那一天不会到达,有时候会觉得很遥远,但我非常有信心”,但“如果唯一秘诀是扩大现有的transformer网络,我认为这不会让我们到达那里,我们仍需要额外的技术突破”。

李飞飞

如果我们将自己传送回历史上的任何时刻——发现火的时刻、制造蒸汽机的时刻、发现电的时刻,我认为我们的讨论会非常相似:技术的双刃剑。

技术赋予了力量,但随着这种力量而来的是危险。我认为AI亦是如此。

李飞飞教授比大多数人更了解她所描述的承诺和危险。她的研究为当今的AI图像识别系统奠定了基础,扩大了AI在医疗保健领域的应用。

最近,随着AI开发者使用更多算力来训练他们的系统,学术界在训练AI系统时面临资金压力,李飞飞教授表示“担心学术界和工业界在全球资源上的差距”。

Yann LeCun

我可以保持沉默,但这不是我的风格。

《时代》对LeCun的描述是“他依然敢于发表大胆而具有争议性的言论,与任何不同意他观点的人进行争论”。

此外,LeCun也表示目前大语言模型的工作效果虽令人感到惊讶,但这还远远不够。如果仅通过让这些系统变得更大,在更多数据上训练模型,我们无法达到人类的智能水平。

我一直在试图通过说“等一下,这并不是游戏的终点”让大家的兴奋情绪稍微冷静下来。

Geoffrey Hinton

这些东西(AI)将会变得比我们更聪明并接管一切。如果你想知道那感觉如何,去问问一只鸡。

76岁的Hinton一直致力于构建模仿人脑的人工智能系统,2013年加入谷歌。他一直认为人脑比他和其他人构建的机器更强大,通过使机器更像大脑,能让机器变得更强大。

但在二月份,他意识到“我们现在拥有的数字智能可能已经比大脑更强大了,只是规模还不够大”。

五月份,Hinton辞去了他在谷歌的副总裁和工程研究员职务,随后接受了一系列采访。采访中他解释辞职是为了能够自由地发表对AI危险的看法,并且他对协助推动该技术而感到后悔。

Yoshua Bengio

如果我们能够将出现不良事件的概率降低十倍,那么,让我们去做吧。

五月份,现已59岁的Bengio公开谈论AI风险。他和Hinton认为,未来5-20年内将开发出在所有任务上都优于人类的AI。

而他对AI快速发展可能带来的风险表示担忧,“在心理上非常具有挑战性,是因为意识到你一直在努力做的事情,以为是一件对社会、对人类、对科学都有益处的伟大的事情,但实际上可能会是灾难性的”。

参考链接:

[1]https://time.com/collection/time100-ai/?utm_source=roundup&utm_campaign=20230202