旷视开启自动驾驶落地!千元成本,纯视觉小算力大能力

智能汽车领域,一个AI行业的big name杀进场。交出了这样的智能驾驶量产方案:

视觉为主,全栈算法自研,成本千元级别。

最惊奇的是,仅仅用现在主流方案1/6-1/5的算力,跑通BEV+Transformer的大规模感知模型。而这,正是目前竞争最激烈的城市、高速NOA功能实现的基础。

而且已经进入车企定点名单,明年上半年就能量产上车。

该团队透露,智能车项目自启动,不过做了2年多时间,却追赶了行业平均5-6年的进度。

智能车赛道这位“亮相即交卷”的闯入者,是AI明星公司、全球计算机视觉最强玩家之一的——旷视科技。

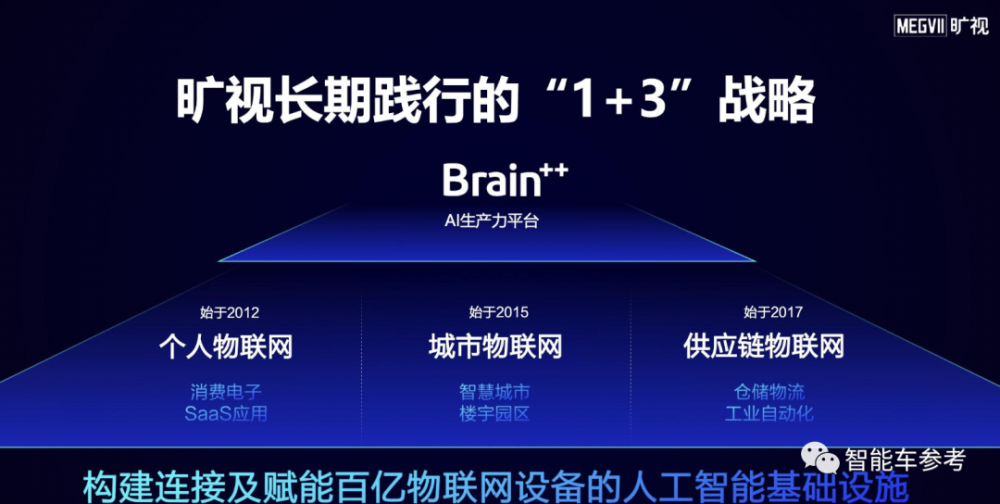

成立十二年,计算机视觉算法能力已臻化境,并开拓了城市、消费、供应链等业务场景,还早已实现规模化营收。

但智能车业务,之前旷视低调十足,不为外人道。

为什么现在亮相?怎么做智能汽车?有什么独特优势?最重要的,车企买帐吗?

现在,一系列疑问都可以直接找旷视专门负责自动驾驶的业务高管谈。

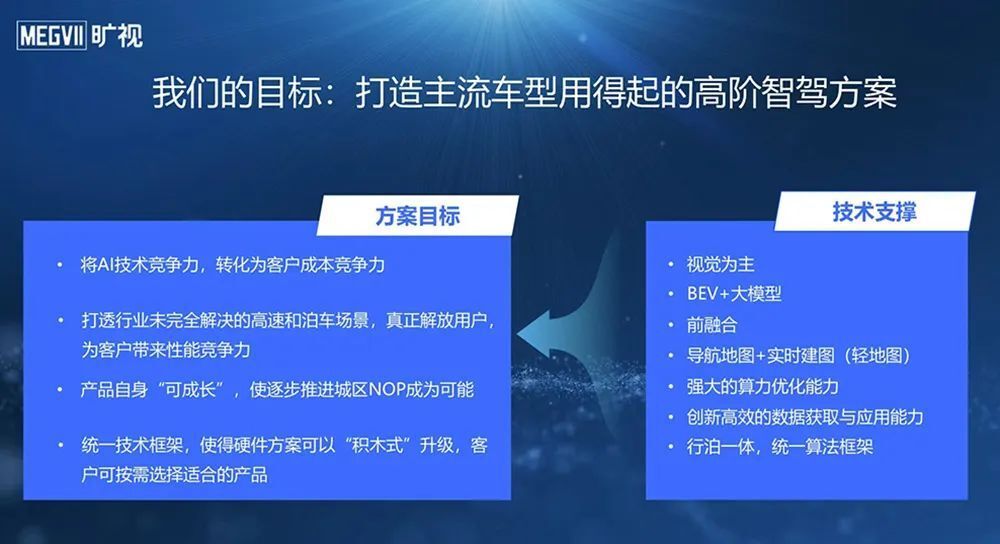

旷视拿出了什么样的智能车方案

旷视拿出的方案不是技术演示,也不是“高举高打”的高阶自动驾驶降维技术体系,而是极其务实、强调量产和规模化的辅助驾驶方案。

根据传感器配置、算力大小分为三个。

标准版方案,满足基础、高频使用智能驾驶场景,功能包括L2全家桶。亮点之处在于它的上限:标配自主泊车、记忆泊车,以及高速高架NOP功能。

所谓NOP,就是行业内常说的领航辅助驾驶,通常叫法是NOA。NOA开启时,用户仅需作为安全员,车辆全部驾驶任务由系统完成,并且能根据地图导航信息自行选择路线、车道和行进策略。

标准版方案面向10-15万元车型,这也是旷视智驾方案的第一个特征,就是将“入门版智驾”门槛拉的极高,15万左右的经济性家用车,高速NOP起步,以及增添了记忆泊车功能。

专业版方案,在标准版上,增加城市NOP功能,以及跨车道安全停车。面向15-30万车型。

以上两个方案,都是没有激光雷达的,视觉为主+毫米波雷达。

最后还有一款面向30万以上车型的旗舰版方案,官方描述为“更多的冗余”,实现“增强城市NOP”功能。

不出意外的话,更多冗余代表着更大的算力,比如英伟达Orin,以及激光雷达。

旷视高级副总裁,自动驾驶业务负责人刘伟透露,标准版和专业版是目前商业上主推的两个方案,几乎覆盖乘用车销售的绝大部分车型。

旷视的方案可以算是行业内首个实现“低算力、高功能”的。并且还有一个“行业首次”:入门即标配高速NOP。

按照以往的固有思路,要实现某一程度的智能驾驶功能,就必须有足够多的传感器冗余,以及足够大的算力支撑。

比如L2+阶段,至少需要数百TOPS算力,以及激光雷达+毫米波雷达+摄像头的传感器方案,L4则至少需要1000TOPS。

但也有一个现象是,堆到1000TOPS算力的量产车,其功能体验也没有超出L2范围。

这是不是意味着,智能驾驶类似ChatGPT这样“大力出奇迹”的转折点仍未到来,现阶段要实现智能驾驶的规模化普及和降本,“算法上精耕细作+尽量榨干硬件潜力”才是更符合技术发展规律和商业逻辑的道路?

所以旷视智能驾驶方案走了一条极致性价比的道路,在智能驾驶套件中,把相同技术指标要求的硬件成本,降到前所未有的低。

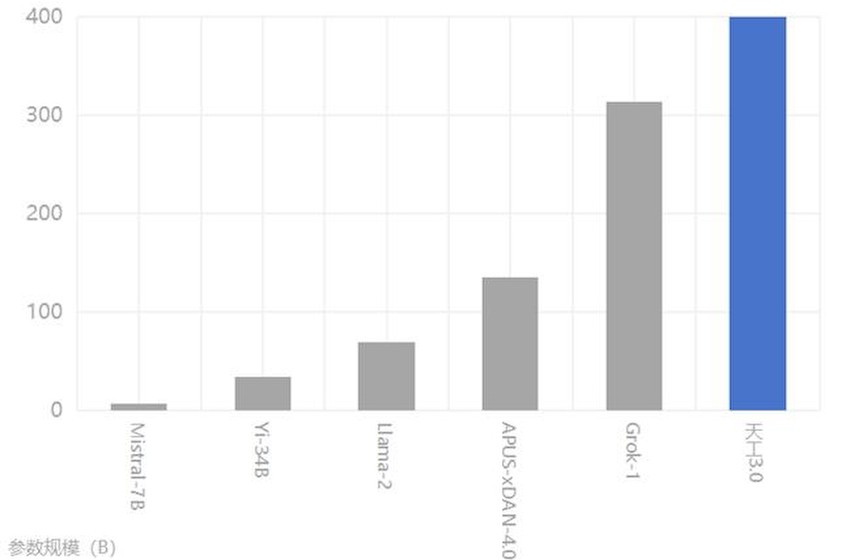

横向比较来看,旷视标准版方案,据官方介绍仅需主流英伟达Orin 1/5,甚至1/6的算力(大约40-50TOPS),就能实现高速NOP功能。

而目前大部分量产智驾方案,至少需要一整块Orin(254TOPS)作为主系统和冗余的算力支持。

这样一来,旷视在面向售价为10-15万元的车型上,就能灵活搭配成本低得多的英伟达Orin N、地平线J5、黑芝麻A1000等等产品,车企完全能接受。

这属于在底层计算平台上降本。

还有一个特点就是“视觉为主,无激光雷达”。属于在上层传感器层面降低成本,而且降本的主力。

旷视科技的智驾方案在行业中至少降本20%。

如何实现低算力高功能

技术上来看,旷视实现“极致性价比”的核心原因在于算法、算力,以及工具链的积累。

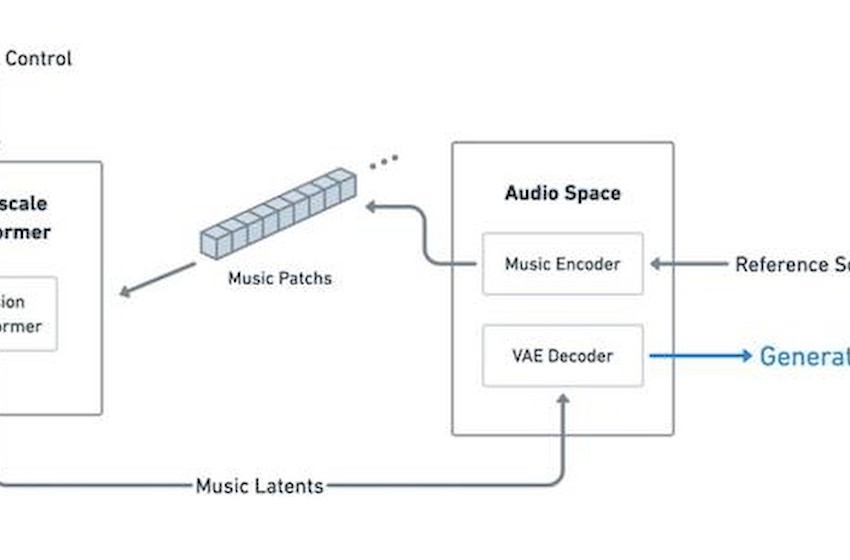

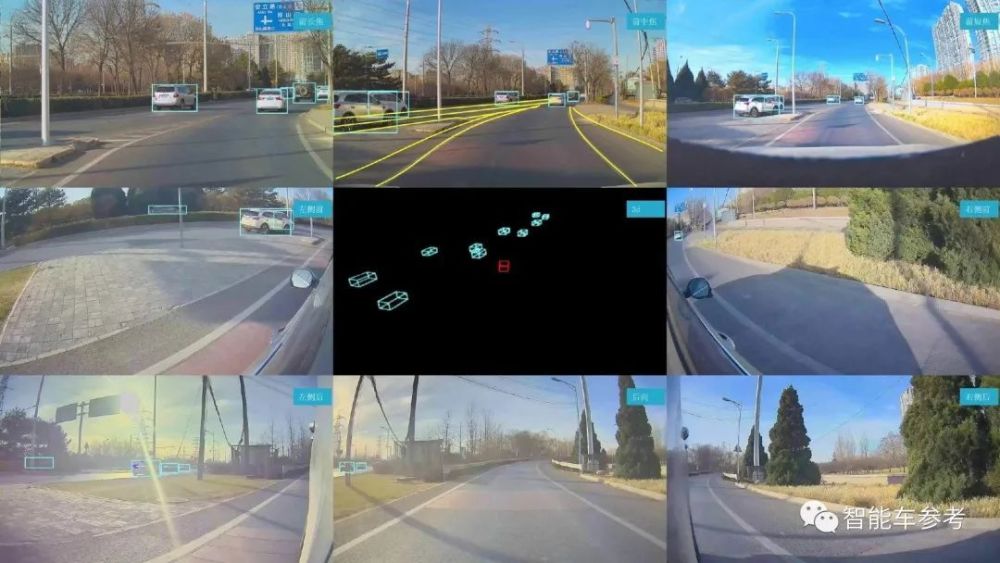

原创算法,这是旷视的技术底座。以视觉为主,采取“BEV+前融合”的方案,砍掉激光雷达,减少对毫米波雷达的使用。但以视觉为主的技术路线,对感知识别算法要求极高。

旷视对BEV有两个实现的算法模型,一个是BEVDepth系列,一个是PETR系列,都是旷视研究院提出的视觉3D感知模型。

PETR框架能同时进行3D目标检测、BEV(Bird’s Eye View,鸟瞰图)分割和3D车道线检测等多项感知任务,引入3D position embeding(3维位置映射),实现不依赖于BEV特征的时序对齐并支持BEV分割,避免了BEV可能的信息损失。

BEVDepth是一种带有显式深度监督的多视图 3D 目标检测新网络,利用编码的内在和外在参数获得明确的深度监督,并进一步引入了深度校正子网络来抵消由投影引起的干扰。

如果有些芯片对于Transformer的算子支持不太好可以采用BEVDepth;如果对于Transformer的算子支持非常好,那采用PETR。

BEV+Transformer架构最早由特斯拉在2020年引入。不过不同于特斯拉占用网络采用的稠密算法,旷视的PETR系列在输出对周围环境的各种感知表征时,采用的是稀疏算法。

用稀疏的方式来做Transformer,同样能非常好地检测到长尾场景中的障碍物,同时还对算力要求更低,低算力高功能的核心就是这项技术。

除了这两个核心算法,旷视还有基于物体点解决漏标和多标等问题的半监督检测算法 PointDETR、一个锚点检测多个物体,性能全面超越主流DETR目标检测器AnchorDETR等等。

算力基础设施,旷视到目前为止,已经构建了一万多张卡的计算集群,快速迭代能力同样是大模型实力的基础。

另一方面,为了降本,旷视还对“统一算法框架”做了大量工作。

一般而言,从旗舰车型到入门级车型,一家主机厂每种车型采用的配置方案都各不相同,供应商方案相当复杂,这导致车辆在推出量产时,无论是把握节奏、质量、成本,还是管理和维护不同供应商,都很难控制。

旷视在做的,把适配各种定位车型的智能驾驶系统,都采用统一的BEV算法框架,做到算法平台化、硬件平台化。比如在适配高中低不同算力的芯片时,旷视采用Pin-to-Pin的系列芯片,即同一套域控可以直接适配不同芯片硬件,如果域控需要适配高算力芯片,就换高算力芯片,如果要适配低算力芯片,就换一个低算力的芯片。

做到这一点后,主机厂各个车型的量产速度将大大加快,质量更好的同时,成本也将大幅降低。

在硬件配置方面,旷视则坚持走以视觉为主的感知路径,支持采用实时建图的感知方式,只用导航地图,不用高精地图。

除此之外,旷视还能做到直接去掉RTK(实时差分定位,高精度测量方法)。去掉这两项,每套套件又能节省数百元的费用。

总计一下,旷视智驾方案的技术特征或比较优势,有以下这些:

业内首个实现长达300米距离视觉感知。

业内首个将 [BEV+Transformer] 感知算法模型,运行在低算力芯片平台。

业内首创鱼眼BEV模型,感知范围扩大三倍。基于BEV+Transformer] ,在泊车场景下车位的感知距离可达30米(传统方案支持约8米左右),3D感知定位能力接近激光雷达。

支持3D地图构建,不依赖于高精地图便可实现高速和城区NOP去RTK定位算法,定位能力达到RTK方案水平。

端到端Transformer大模型进展迅速,已经在Orin平台实现感知、建图、跟踪、预测4合一模型。

除了智能驾驶,旷视在智能座舱领域也开始了布局。相关的技术,依托12年技术研发,早已有积累。

目前的状态是和主机厂协商,瞄准下一代智能座舱产品进行预研。

比如,旷视认为智能座舱会成为大模型落地的重要场景。这首先会带来感知能力的进一步提升。但落到产品体验层面,更重要的还是决策。

比如智能汽车的底盘、空气悬挂、刹车系统、车窗、灯光氛围,几乎所有东西能被控制。但是,这么多东西都用触摸屏、语音的方式进行交互吗?显然不可能。

旷视基于AI生产力平台Brain++的能力,未来会聚焦于智能座舱的决策引擎。同时,结合在芯片、软件算法方面的能力,形成覆盖感-知-决的智能座舱产品体系。

而在基础的在“感”和“知”上面,旷视目前已经拥有相对成熟的产品积累。例如IMS双光融合传感器,以及在“知”上面的DMS/OMS SDK等。

旷视做智能汽车的逻辑

智能汽车赛道之所以火热,是因为智能汽车本身就是AI能力的综合载体,又是一个融合了汽车工业和科技产业,“含金量”无法估量的大赛道。

这是不能错过的商业前景。有实力的AI玩家,几乎都时不我待的投身其中。

另一方面,无论智能驾驶和智能座舱,计算机视觉技术都是重要基座。

2006年Hinton提出深度学习。包括旷视在内的第一批AI创业公司,都敏锐地抓住了深度学习和计算机视觉技术结合带来的机会,并为它们找到了合适的落地场景。

比如旷视的三大业务场景:消费、城市、供应链。这些业务成了旷视成为平台型AI“巨头”的支柱,计算机视觉技术也成为了旷视自身优势的来源。

所以,于时势、于商业、于技术,旷视入局智能车,只是个早晚问题。

一直在等待的,是合适的时机和人选。

从早期的辅助驾驶技术开始,主流的技术路线一直是“雷达+视觉”。

而且因为早期深度学习算法还不成熟,彼时视觉数据只是作为辅助,智能驾驶绝大部分功能,依赖毫米波雷达。

但毫米波雷达本身存在局限:精度有限、缺失物体高度信息,以及最致命的,是对静止物体感知不佳。

所以旷视认为,基于RV(雷达+视觉)的传统算法,是不可能解决高阶智能驾驶问题的,而自己的优势又集中在计算机视觉算法,因此一直选择观望,等待一个技术层面的突破。

直到2020年,特斯拉首次提出BEV算法,并且成功用8个摄像头的数据实现了NOA功能的演示,纯视觉路线的一扇窗突然被打开。

BEV+Transformer的技术路线,跟旷视长处完美结合,于是开始迅速跟进。并且明确以商业化落地为目标确定研发方向:

目前的智能汽车L2以下基本上是标配。现在的重点,是在L2到L3之间。旷视判断接下来两三年的时间,高速NOP肯定会快速普及。

阻碍高阶智驾方案落地的,首先是性能,第二是成本。旷视所有的技术研发都是基于这两个方向展开的。而体验好、成本低的高阶智能驾驶产品,必须要有非常强的AI能力支撑。

同时为了支持智能车业务,旷视组建了一支数百人的团队,其中超过2/3是研发人员。

带领这支队伍的关键人物刘伟,曾担任SAP全球副总裁,微软渠道事业部总经理。有消费电子、车载AI方案、智能传感器、计算芯片等领域丰富的落地经验。

这也符合旷视一直以来具体业务落地的风格——寻找一个有行业背景或商业化knowhow的高管。

所以旷视进军智能车业务的逻辑,可以简单总结为这样的一句话:

这件事有前景,自身技术实力又有积累,现在产业链条件刚好又足以支撑“极致性价比”的产品策略。

智能车业务亮相,重估旷视

旷视智能车业务亮相,对于这个行业来说是一个明显的转折点。

从透露的智驾方案配置来说,旷视首次把高阶智驾功能,标配给10-15万入门车型。

这是全球智能汽车产业L2+功能普及的开端,也是汽车工业智能化革命更加深化的标志。

另外,旷视将高阶智驾门槛降得前所未有的低,性价比做的前所未有的高,以及把这条赛道的技术天花板,拉的史无前例的高。

这意味着,一轮更加剧烈的行业内卷已经开始。

有利于技术迭代推陈出新,有利于用户消费体验。

而对于旷视自身的发展来说,进军智能车,也释放了新的信号。

旷视在过去,一直聚焦在AIoT领域。在消费物联网、城市物联网和供应链物联网三大场景展开落地。

这些业务场景,都以计算机视觉技术作为依托,这也是旷视创业的根基。

而在12年之间,旷视除了在算法层面深耕,更重要的的是积累了AI生产工具和“方法论”,实现快速生产、敏捷开发。

这是一种更广义的AI技术“泛化”能力,即把相同的算法软件框架,快速应用到不同的场景、行业和产品形态上。

不一定是简单的核心算法通用,更重要的是算法生产工具,平台工具链发挥作用。

所以理解旷视入局智能车,不能简单的把它作为一个智能驾驶技术供应商,而应该纵向连接起它的历史——

旷视一直是一个以算法为基础,软硬一体为核心的智能机器人公司。

智能汽车,是一个控制维度最少(横纵两向),目前产业化最成熟的“机器人”罢了。

事实上,旷视、大疆、商汤这类“平台型”AI公司,业务顺理成章延伸到智能汽车,也是某种意义上AGI的萌芽和开端。

旷视科技,毫无疑问是中国乃至全球最具价值的AI视觉公司之一。

而现在,加上自动驾驶场景,智能车业务……旷视,到了该被重估的时候。

— 完 —

【智能车参考】原创内容,未经账号授权,禁止随意转载。